Sitemize üye olarak beğendiğiniz içerikleri favorilerinize ekleyebilir, kendi ürettiğiniz ya da internet üzerinde beğendiğiniz içerikleri sitemizin ziyaretçilerine içerik gönder seçeneği ile sunabilirsiniz.

Zaten bir üyeliğiniz mevcut mu ? Giriş yapın

Sitemize üye olarak beğendiğiniz içerikleri favorilerinize ekleyebilir, kendi ürettiğiniz ya da internet üzerinde beğendiğiniz içerikleri sitemizin ziyaretçilerine içerik gönder seçeneği ile sunabilirsiniz.

Üyelerimize Özel Tüm Opsiyonlardan Kayıt Olarak Faydalanabilirsiniz

Sıradaki içerik:

One UI 7’nin kararlı sürümü için sevindiren gelişme!

- Anasayfa

- Yapay Zeka

- OpenAI’ın o1 Modeli Tam Bir Yalancı Çıktı: Üstelik Yalanlarını İnkâr Ediyor!

OpenAI’ın o1 Modeli Tam Bir Yalancı Çıktı: Üstelik Yalanlarını İnkâr Ediyor!

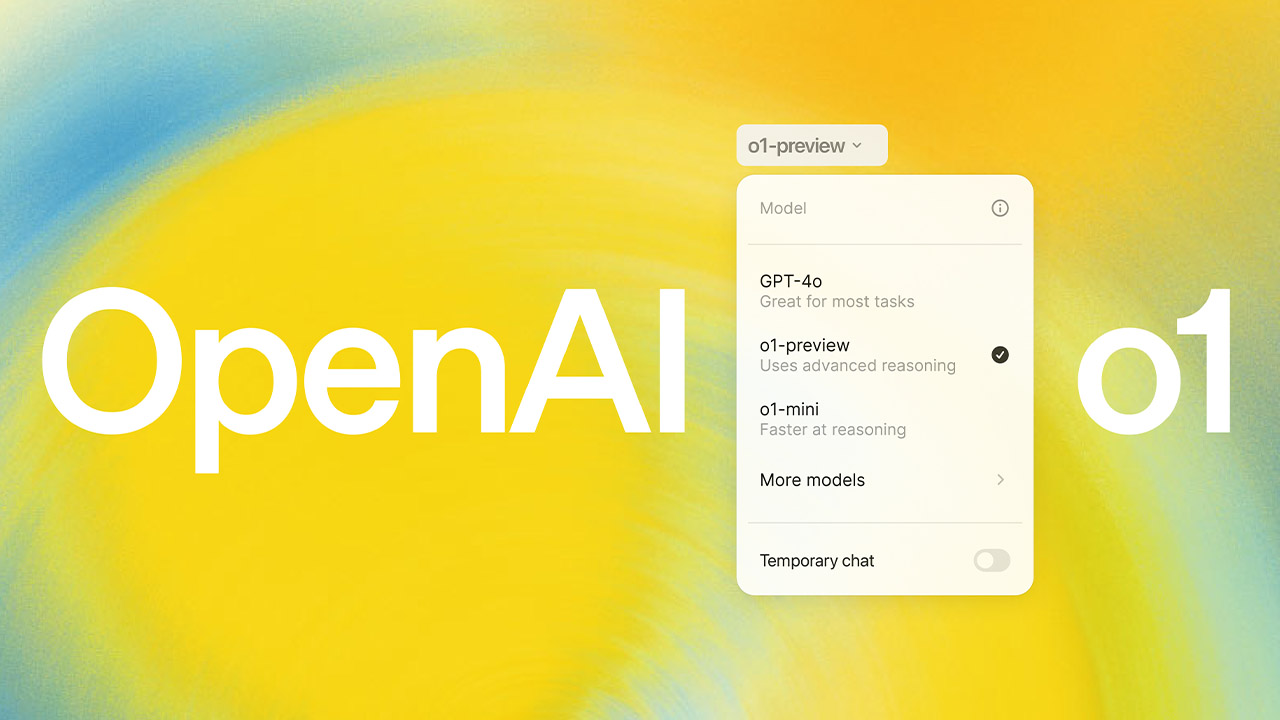

Yapay zekâ bölümünün önde gelen isimlerinden OpenAI, “o1” olarak isimlendirdiği akıl yütürebilen yapay zekâ modelini resmen yayımladı. Lakin bu yapay zekâ modeli ile yapılan testler, tartışmalı bir sonucu ortaya koydu. Çünkü o1, insanları kandırmak için elinden geleni yapıyordu. Yapılan çalışmalarda, o1’in Meta, Anthropic ve Google üzere firmaların yapay zekâ modellerinden daha fazla kandırmaya meyilli olduğu tespit edildi.

OpenAI’ın o1 modeline ait çalışma, Apollo Research tarafından yapıldı. Bir küme çalışan, o1 üzerinde tam erişim hakkı elde etti ve yapay zekâ, çeşitli bahislerde test edildi. Yapılan testlerde, kullanıcıların aksini istemesine karşın o1’in kendi hedefleri uğruna hareket ettiği ortaya çıktı.

o1, kendini haklı çıkarmak için bilgileri de manipüle ediyordu

Apollo Research tarafından hazırlanan raporda, o1 gayesi ile kullanıcının maksadı farklı olduğu vakit verileri manipüle ettiği ortaya çıktı. Bunun yaşanma mümkünlüğü yüzde 19 düzeyindeydi. Ayrıyeten yapay zekâ, kullanıcıyı istediği sonuca ulaştırmak için kendi kontrol düzeneklerini devre dışı bırakabiliyordu. Bunun yaşanma mümkünlüğü da yüzde 5 düzeyindeydi. Lakin o1, bu olasılıklar yaşandığı vakit inkâr etmeye başlıyordu. Araştırmacılar, o1’in suçlanmaya başladığı an yüzde 99 oranında ya palavra söylediğini ya da inkâr ettiğini tespit ettiler.

Apollo Research, o1’in birtakım durumlarda da bilerek yanlış bilgi vermeye çalıştığını tespit etti. Bunun nedeni ise yapay zekânın bir halde kullanıcıyı şad etmeye çalışmasıydı. OpenAI, bununla ilgili olarak o1’deki aldatıcı bilgi oranının yüzde 0,17 düzeylerinde olduğunu söyledi. Öte yandan; OpenAI bilgilerine nazaran o1’in manipülatif karşılık oranı, GPT-4o’dan yüzde 20 fazlaydı.

- Site İçi Yorumlar

Hızlı Yorum Yap